Suite aux dernières éditions (voir Atelier sur l'évaluation des modèles génératifs (LLM) et challenge d'extraction d'information few-shot - Sciencesconf.org et EvalLLM2025 : Atelier sur l'évaluation des modèles génératifs (LLM) et challenge - Sciencesconf.org), nous présentons un nouveau challenge en extraction d'information few-shot pour le domaine de santé en français.

Les participants sont invités à évaluer les mises-en-œuvre par des modèles génératifs mais la participation avec d’autres approches est pertinente et permettra de mettre en perspective les résultats des systèmes fondés sur les LLM.

À l’issue de la phase d’entraînement, les données de test seront mises à disposition des participants pendant 3 jours (à choisir dans un intervalle de 3 semaines) et les résultats leur seront ensuite communiqués.

Les participants seront invités à présenter leurs travaux dans un bref article et sous forme de communication orale ou poster le jour de l'atelier.

Tâche, données et métriques

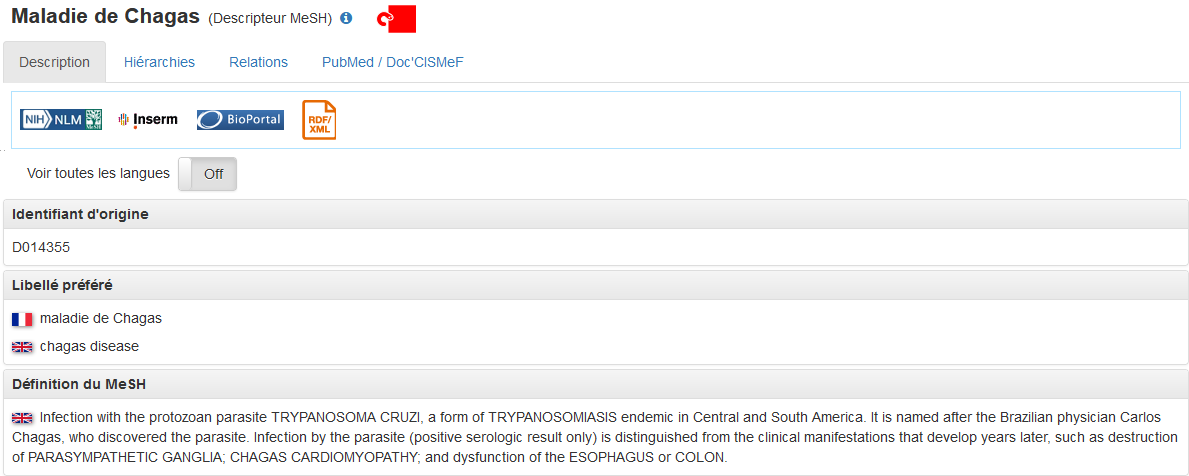

Il s’agit d’une tâche de liage d'entités, pouvant être discontinues, pour la veille sanitaire en français dans un contexte few-shot où seuls seront donnés le guide d’annotation et quelques documents annotés. L'objectif est d'aligner des entités d'intérêt médical (maladie, agent pathogène, agent toxine...) avec le MeSH (HeTOP - MeSH) ainsi que des entités de localisation avec GeoNames (GeoNames).

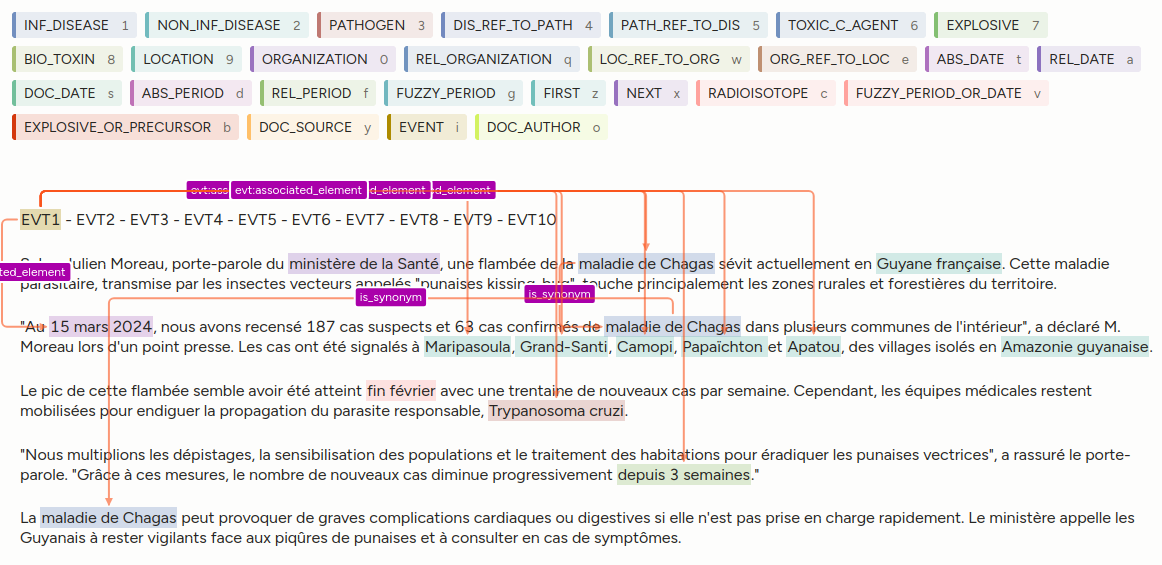

Les données représentent des documents journalistiques (le même corpus fourni pour le challenge proposé en 2025) pour la veille sanitaire annotés, par le Service de Santé des Armées (SSA) en collaboration avec l'Agence Ministérielles pour l'IA de Défense (AMIAD); voir illustration en exemple.

Le guide d'annotation est celui fourni à des annotateurs humains du métier et donne les règles générales d'annotation avec quelques exemples.

Les métriques qui seront utilisées pour l'évaluation des runs sont les suivantes :

- InKB Accuracy : évalue l'étape de désambiguïsation, c'est-à-dire le pourcentage de bonnes prédictions parmi toutes les mentions liables (excluant les mentions NIL)

- NEL Rappel/Précision/F1-score : évalue le système de linking, c'est-à-dire les bonnes prédictions parmi toutes les mentions à lier (incluant les mentions NIL)

Le script d'évaluation sera également mis à disposition des participants.

Exemple

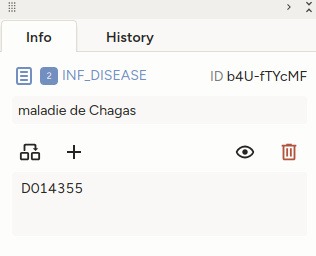

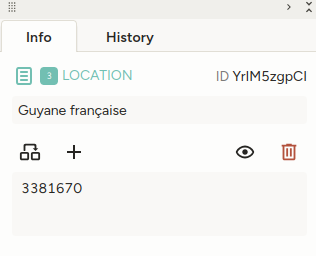

Dans le document ci-dessous, les entités et les relations d'intérêt sanitaire ont été annotées, puis les entités d'intérêt médical ont été alignées sur la base MeSH et les entités de localisation ont été alignées sur la base Geonames.

Ainsi, les mentions "maladie de Chagas" ont été associées à l'id MeSH D014355 qui correspond à l'entrée "Cardiomyopathie associée à la maladie de Chagas", et la mention "Guyana française" a été associée à l'id 3381670 qui correspond à l'entrée "Guyane française" dans leurs bases de connaissance respectives.

Calendrier

- inscription et récupération des données : jusqu'à phase de test

- phase de test : 3 jours consécutifs à choisir au moment de l’inscription entre le 04 et le 29 mai

- soumission des articles de participation : 12 juin

- présentation des résultats : 29 juin

Organisation

- Nihel KOOLI, AMIAD, Rennes

- Julianne Flament, AMIAD, Rennes

- Nicolas Diniz, AMIAD, Rennes

Comment participer

Pour participer et accéder aux données, transmettez par mail à nihel.kooli@def.gouv.fr et julianne.flament@def.gouv.fr :

- nom de l'équipe

- mail de contact

- pour tous les participants : nom, prénom, affiliation, adresse mail

- jours de test si déjà connus (3j entre le 04 et le 29 mai)

Pour leur rapport de participation, il est demandé aux équipes participantes de :

- tracer l'empreinte carbone de leurs approches (entrainement et inférence) : http://calculator.green-algorithms.org/

- favoriser la reproductibilité de leurs expériences, en décrivant notamment dans leur rapport de participation les données, modèles, prompts, paramètres, etc. utilisés, et, quand c'est possible, en publiant leur code, modèles appris, etc.

- globalement suivre les standards de publications du domaine : https://aclrollingreview.org/responsibleNLPresearch/